核心看点

• DeepSeek 发布最新技术报告《Thinking with Visual Primitives》(2026.04.30)

• 提出”参考鸿沟”问题:纯语言太模糊,无法精确定位空间布局,导致逻辑崩坏和幻觉

• 创新方案:让模型学会”边推理边指路”,用空间标记(点、边界框)作为最小思维单元

• 在 DeepSeek-V4-Flash 架构上压缩视觉Token,每4个Token合并为1个,效率惊人

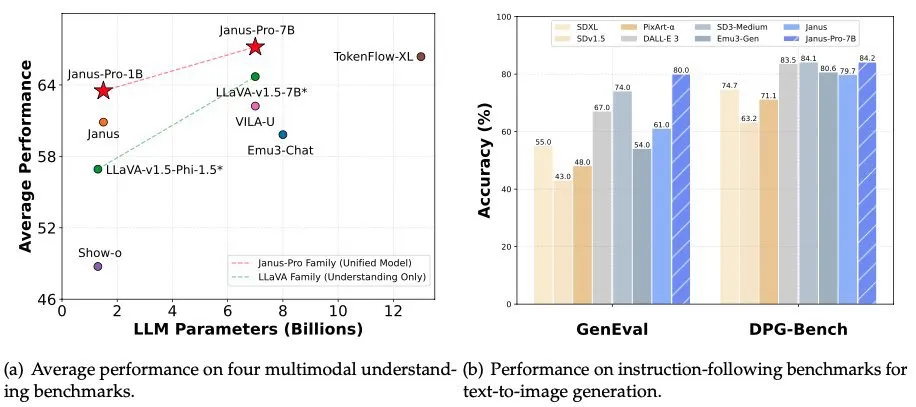

• 在计数和空间推理基准上对标 GPT-5.4、Claude-Sonnet-4.6、Gemini-3-Flash

DeepSeek 今天又放了个大招——发布了一份新的技术报告《Thinking with Visual Primitives》(用视觉基元思考)。

这报告解决的是什么问题?

现在的多模态大模型看图能力已经很强了,但有一个隐藏的瓶颈:当它需要做复杂的空间推理——比如数清楚图里有多少个物体、判断物体之间的位置关系——语言就变得不够用了。

打个比方:你让一个人描述一个迷宫怎么走,用文字说很容易绕晕,但如果你拿手指在迷宫上画一条线,就一目了然。这中间的差距,就是 DeepSeek 提出的”参考鸿沟”(Reference Gap)。

DeepSeek 的解决方案很有意思:不是让模型”看得更清楚”,而是让它”边推理边指给你看”。模型在推理过程中,会直接在图像上标注点、画边界框——这些空间标记成为模型思考的最小单元,就像你用手指指着地图说话一样。

技术实现上,DeepSeek 在 V4-Flash 架构基础上做了优化:每4个视觉Token压缩为1个KV缓存条目,大幅减少了图像Token消耗,但保持了推理深度。

结果呢?尽管模型规模更小、图像Token预算更低,但在计数和空间推理基准测试上,直接对标了 GPT-5.4、Claude-Sonnet-4.6 和 Gemini-3-Flash 这些顶级模型。

DeepSeek 表示未来会逐步开源内部基准数据、冷启动数据子集,以及模型权重。

这份报告对 AI 行业的意义在于:多模态模型的竞争正在从”谁看得更清”转向”谁会推理”。光是能识别图片里的内容已经不够了,能理解空间关系、能结构化推理,才是下一个赛道的入场券。

📄 报告原文:https://github.com/deepseek-ai/Thinking-with-Visual-Primitives

📂 栏目地址:https://www.163264.com/category/baogao

本文地址:https://www.163264.com/11361