【核心看点】

· 蚂蚁百灵大模型Ling-2.6-1T正式开源,参数规模达1万亿

· 采用MLA+Linear Attention混合架构,主打”快思考”,非一味堆长思维链

· 在代码生成、缺陷修复、工具调用等基准上达到开源SOTA水平

【详细解析】

4月30日,蚂蚁集团旗下的百灵大模型正式将Ling-2.6-1T开源。这不是一个简单的”大”模型——它真正有趣的地方在于”思路”。

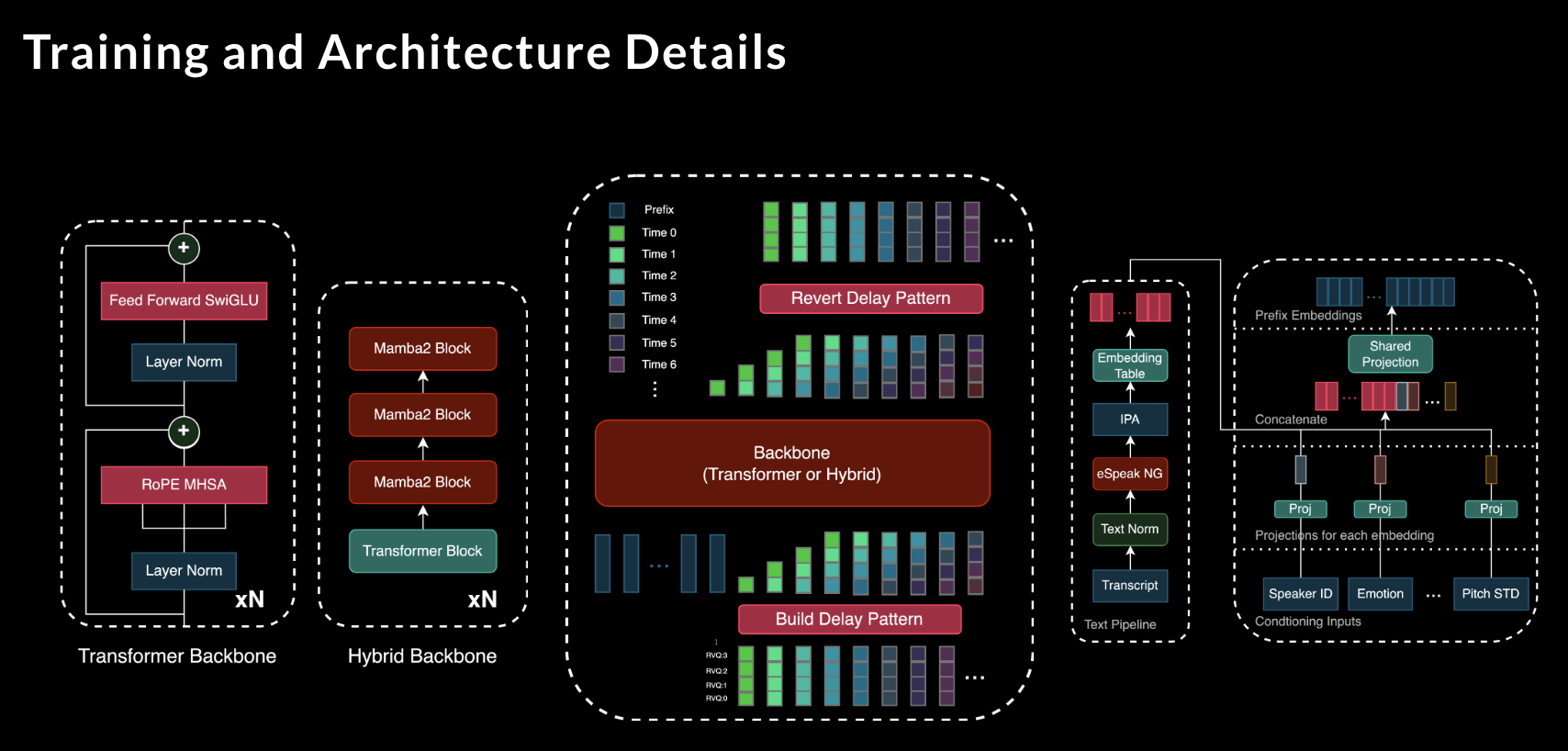

从技术路线来看,Ling-2.6-1T没有跟风”越长越聪明”的堆算力竞赛。它采用MLA(多头潜注意力)与Linear Attention(线性注意力)的混合架构,配合抑制”过程冗余”的强化奖励策略,让模型在1万亿参数的体积下,依然能通过高效的”快思考”直达结果。翻译成人话就是:不烧token,不给废话。

具体性能上,Ling-2.6-1T在AIME’26、SWE-bench Verified、BFCL-V4、TAU2-Bench、IFBench等执行类基准上均达到了开源SOTA,尤其在代码生成和缺陷修复方面表现出色。这意味着它不是一个”聊聊天很厉害”的模型,而是真正能干活、能进生产环境的。

此外,蚂蚁官方宣布将OpenRouter平台的免费API调用服务延期一周,方便开发者体验和评测。模型已在Hugging Face和ModelScope同步上线。

【简评】

1万亿参数≠烧钱。Ling-2.6-1T的”快思考”设计思路值得关注——它证明了在同级别参数下,通过架构创新和训练策略优化,完全可以做到既强又省。对于开发者来说,1T级别的开源模型能跑Agent和代码修复,这对降低AI工程落地门槛是实打实的利好。蚂蚁在开源领域持续发力,值得点赞。

本文地址:https://www.163264.com/11387